DraftMarks: как новый инструмент показывает работу ИИ в текстах студентов

Девяносто процентов студентов колледжей используют ИИ в учебных работах, а половина из них — прямо во время черновика. Это данные отчёта 2025 года. Но если искусственный интеллект стал привычным инструментом, то прежние методы контроля — вроде Грамотности или Тёрнитина — перестали работать: они показывают лишь процент совпадений, а не то, как студент на самом деле работал.

Следы, которых раньше не было

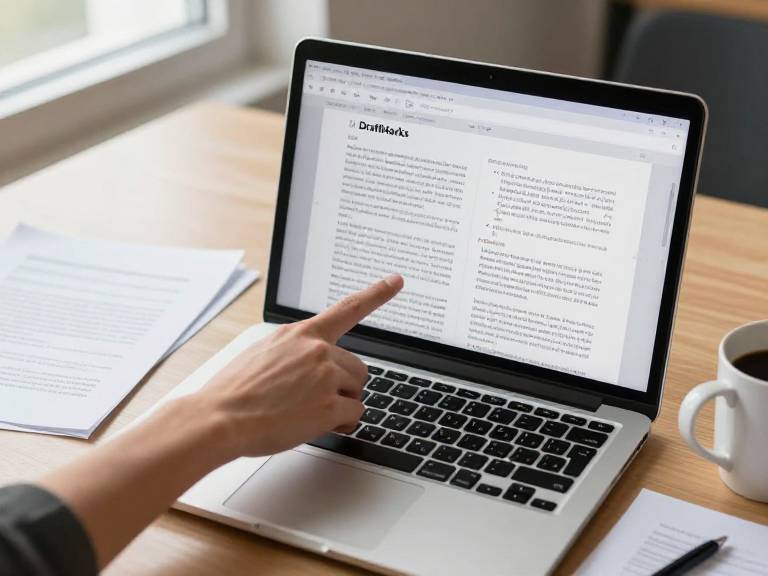

Исследователи из Georgia Tech и Стэнфорда создали DraftMarks — открытый инструмент, который не считает долю ИИ, а визуализирует процесс. Вместо сухой цифры он накладывает на документ графические метки, каждая из которых отвечает определённому типу взаимодействия с нейросетью.

Крошки ластика — сильно переписанные фрагменты. Разводы — изменения, внесённые ИИ, которые затронули силу аргумента, а не только текст. Малярный скотч — пассажи, изначально сгенерированные нейросетью, но оставленные автором. Клей — фрагменты, которые были созданы искусственным интеллектом, а затем удалены. Призрачный текст — момент, когда студент вводил запрос, но решил не использовать результат. Разные шрифты помогают отличить человеческий текст от машинного.

«Эти пометки призваны имитировать письменный процесс так, как мы уже привыкли его понимать», — объясняет Адам Кошиа, аспирант вычислительных наук. «Они помогают студентам и преподавателям увидеть, сколько труда было вложено на самом деле».

Как это работает и чем отличается

Традиционные детекторы ИИ выдают процент — например, 45% текста написано нейросетью. Но эта цифра ничего не говорит о том, как использовалась технология. Автор мог задать общую структуру, а ИИ дописал аргументы, или наоборот — студент сгенерировал черновик и переработал каждое предложение. DraftMarks отслеживает историю версий документа и классифицирует правки почти в реальном времени.

Разработчики начали не с алгоритмов, а с педагогов. В первом исследовании с 21 преподавателем они изучили, на какие визуальные подсказки те обращают внимание, оценивая усилия студента. Оказалось, педагоги интуитивно ищут признаки «ручной работы»: следы правок, неоднородность стиля, перестановки абзацев. DraftMarks просто сделал эти подсказки явными.

Преподаватели, читатели и доверие

Во втором эксперименте участвовали уже 70 человек: студенты, журналисты, обычные читатели и преподаватели. Реакции на аннотированный документ разошлись, и это показательно.

- Преподаватели сосредоточились на процессе: как развивалась мысль, насколько интенсивно использовался ИИ, где студент проявил самостоятельность;

- Обычные читатели через метки оценивали нечто менее конкретное, но не менее важное — доверие к тексту. Для них DraftMarks стал подсказкой об авторских намерениях и аутентичности;

- Сами студенты, по словам участников, начинали иначе видеть собственную работу. Кошиа признаётся: «Я был удивлён тем, как сильно забочусь об авторском замысле, когда могу увидеть, как ИИ меняет мой тон».

От детекции — к осознанному выбору

Авторы инструмента подчёркивают: они не пытаются запретить ИИ или «поймать» студента. Речь о другом — о прозрачности. DraftMarks, по их замыслу, должен помочь пишущему задать себе вопрос: «Я действительно использую ИИ как инструмент или просто пассивно принимаю его подсказки?».

Момин Сиддикуи, магистрант Колледжа вычислительной техники и ведущий автор проекта, формулирует это так: «Когда невидимые части процесса становятся осязаемыми, писатель вынужден признать, действительно ли он вступает в диалог с ИИ или просто бездумно соглашается». Инструмент был представлен в апреле 2026 года на конференции ACM CHI в Барселоне; статья опубликована в трудах конференции.

Подробнее о результатах исследования можно прочитать в оригинальной статье на Phys.org.

Что это меняет в образовании

Сейчас главный вопрос на факультетах — не «используют ли студенты ИИ», а «чему они при этом учатся?». Детекторы вроде Turnitin дают только повод для разбирательства, но не информацию для педагогики. DraftMarks, напротив, превращает взаимодействие с нейросетью в объект для обсуждения и рефлексии.

Представьте: студент сдаёт эссе, и преподаватель видит, что все ключевые аргументы помечены как скотч (сгенерированы ИИ и оставлены без изменений). Это сигнал: автор не переработал материал, не построил собственную логику. А если на том же документе много крошек ластика и следов клея — значит, студент активно редактировал, перекомпоновывал, вступал в диалог с черновиком. Вторая ситуация явно ближе к учебной цели, даже если доля ИИ в финальном тексте высока.

Впрочем, не всё так однозначно. Некоторые участники исследования жаловались, что визуальный шум от меток отвлекает от содержания. Другие боялись, что метки «скотча» или «разводов» будут стигматизировать студентов, заставляя их скрывать любую помощь ИИ, даже разумную. Разработчики признают: инструмент ещё сырой, и его внедрение потребует новых норм оценки.

Но главный сдвиг уже произошёл. Вместо безнадёжной гонки «ИИ пишет — детектор ловит — студент обходит» появляется альтернатива: сделать взаимодействие с нейросетью видимым и обсуждаемым. Что, если через несколько лет рецензенты будут просить авторов прикладывать не просто финальный текст, а его «карту ИИ-следов»?

Тогда, возможно, исчезнет сама дилемма: списывание или творчество. Останется только один вопрос — насколько осмысленно человек распорядился инструментом, который у него в руках.